Google je z novo tehnologijo TurboQuant sprožil odziv na finančnih trgih in odprl pomembno vprašanje prihodnosti umetne inteligence. Nova rešitev obljublja bistveno manjšo porabo pomnilnika, hitrejše delovanje modelov AI in možne spremembe pri stroških podatkovnih centrov. Nedavna objava Googlove raziskave je hitro odjeknila na finančnih trgih in znova odprla vprašanje, koliko pomnilnika bo umetna inteligenca sploh še potrebovala v prihodnje.

Po objavi na uradnem Googlovem blogu so delnice večjih proizvajalcev pomnilniških rešitev hitro zdrsnile. Micron je izgubil 3 odstotke, Western Digital 4,7 odstotka, SanDisk pa 5,7 odstotka. Vlagatelji so se odzvali na možnost, da bi nova tehnologija lahko občutno zmanjšala potrebe po pomnilniku v industriji umetne inteligence.

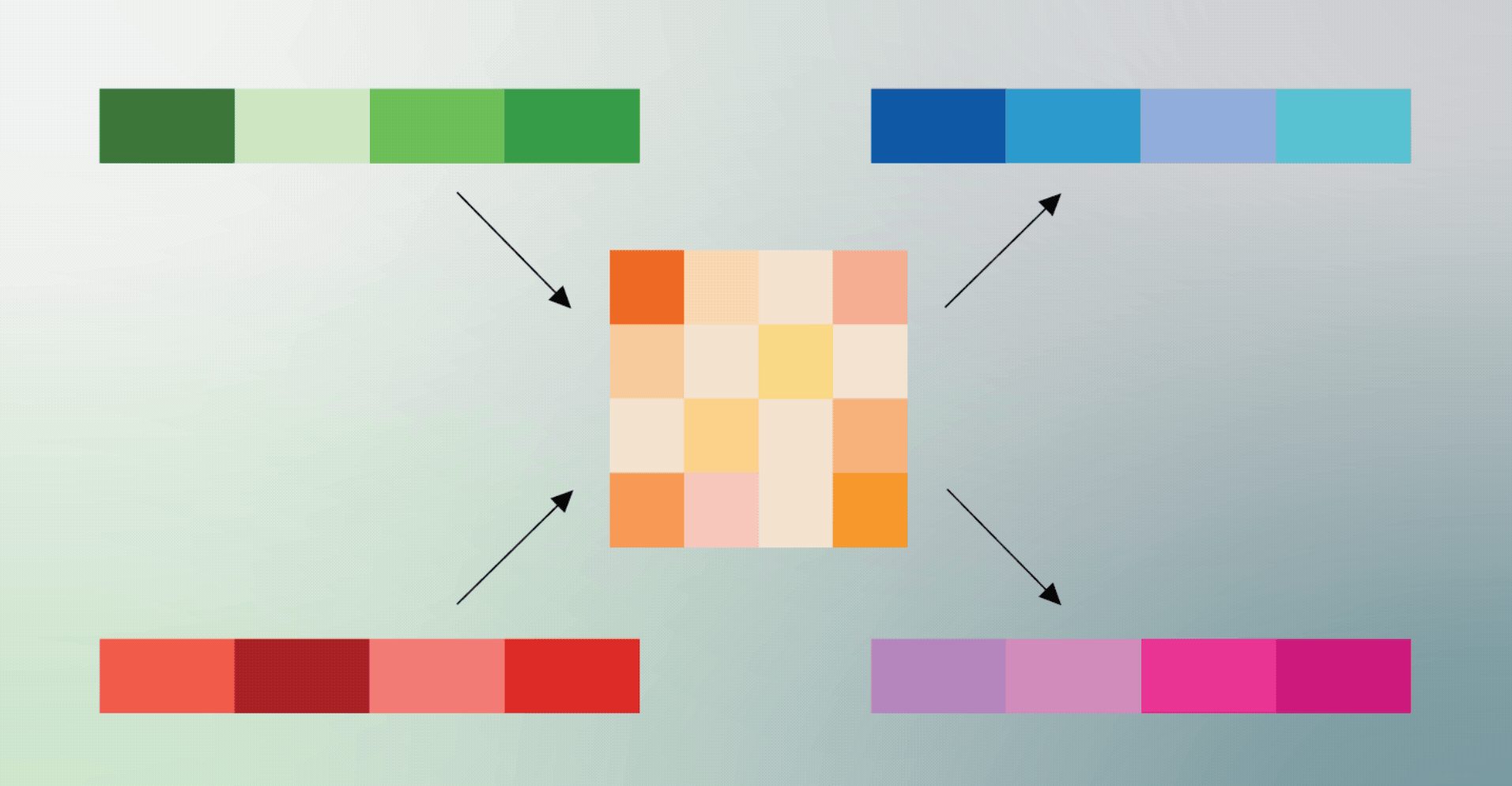

V središču pozornosti je algoritem TurboQuant, ki ga je Google razvil skupaj s partnerji Google DeepMind, KAIST in New York University. Rešitev je namenjena učinkovitejšemu upravljanju tako imenovanega key-value cache predpomnilnika, ki ga uporabljajo veliki jezikovni modeli oziroma LLM pri obdelavi dolgih besedil.

Prav ta del sistema je eden ključnih porabnikov pomnilnika na grafičnih procesorjih GPU, še posebej pri zmogljivih AI modelih. TurboQuant naj bi ta predpomnilnik stisnil na 3 bite na vrednost, medtem ko je danes standard 16 bitov. To pomeni do šestkrat manjšo porabo pomnilnika brez merljive izgube natančnosti.

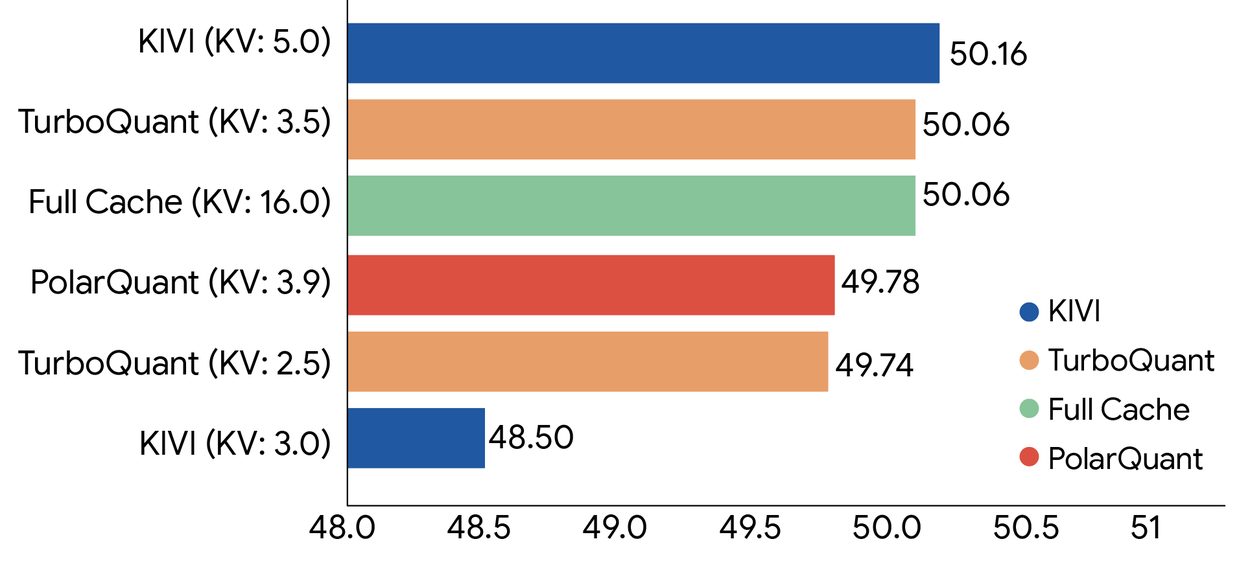

Googlove meritve kažejo tudi na visoko zmogljivost v praksi. Pri testiranju na odprtokodnih modelih Gemma, Mistral in Llama je TurboQuant dosegel ali presegel rezultate starejšega standarda KIVI. Na grafičnih procesorjih Nvidia H100 pa je sistem pri 4-bitni natančnosti omogočil kar osemkrat hitrejše izračune v primerjavi z nekompresirano 32-bitno osnovo.

Novost je pomembna predvsem zaradi vse večjih stroškov, ki jih imajo podjetja z vsakodnevnim izvajanjem modelov umetne inteligence. Čeprav je treniranje AI modelov zelo drago, o dobičkonosnosti pogosto odloča prav inferenčno izvajanje, torej vsakodnevna obdelava milijonov uporabniških poizvedb.

Zato bi lahko podobne optimizacije pomembno vplivale na stroške AI infrastrukture, podatkovnih centrov in nakupov strežniške opreme. Kljub temu analitiki opozarjajo, da večja učinkovitost še ne pomeni nujno manjše porabe. Zgodovina računalništva namreč kaže, da nižji stroški pogosto vodijo v še širšo uporabo tehnologije.

Za Google pa pomen TurboQuanta presega jezikovne modele. Po navedbah raziskave je tehnologija zelo uporabna tudi za vektorsko iskanje, ki poganja priporočila na YouTubu, iskalne sisteme in digitalno oglaševanje.

V prihodnjih mesecih bo bolj jasno, ali bo TurboQuant res zmanjšal stroške infrastrukture za umetno inteligenco ali pa bo svetovno povpraševanje po računski moči še naprej raslo enako hitro.